- #Umelá inteligencia

- 3 min.

- 20.4.2024

Microsoft dokáže vygenerovať deepfake video z jedinej fotky a nahrávky hlasu

Generovanie obrázkov, audio nahrávok či priamo videí pomocou umelej inteligencie, je dvojsečnou zbraňou. Aj to je dôvod, prečo sa Microsoft svoj nový model VASA-1 pre generovanie realistických video nahrávok rozhodol sprístupniť zatiaľ iba výskumným tímom.

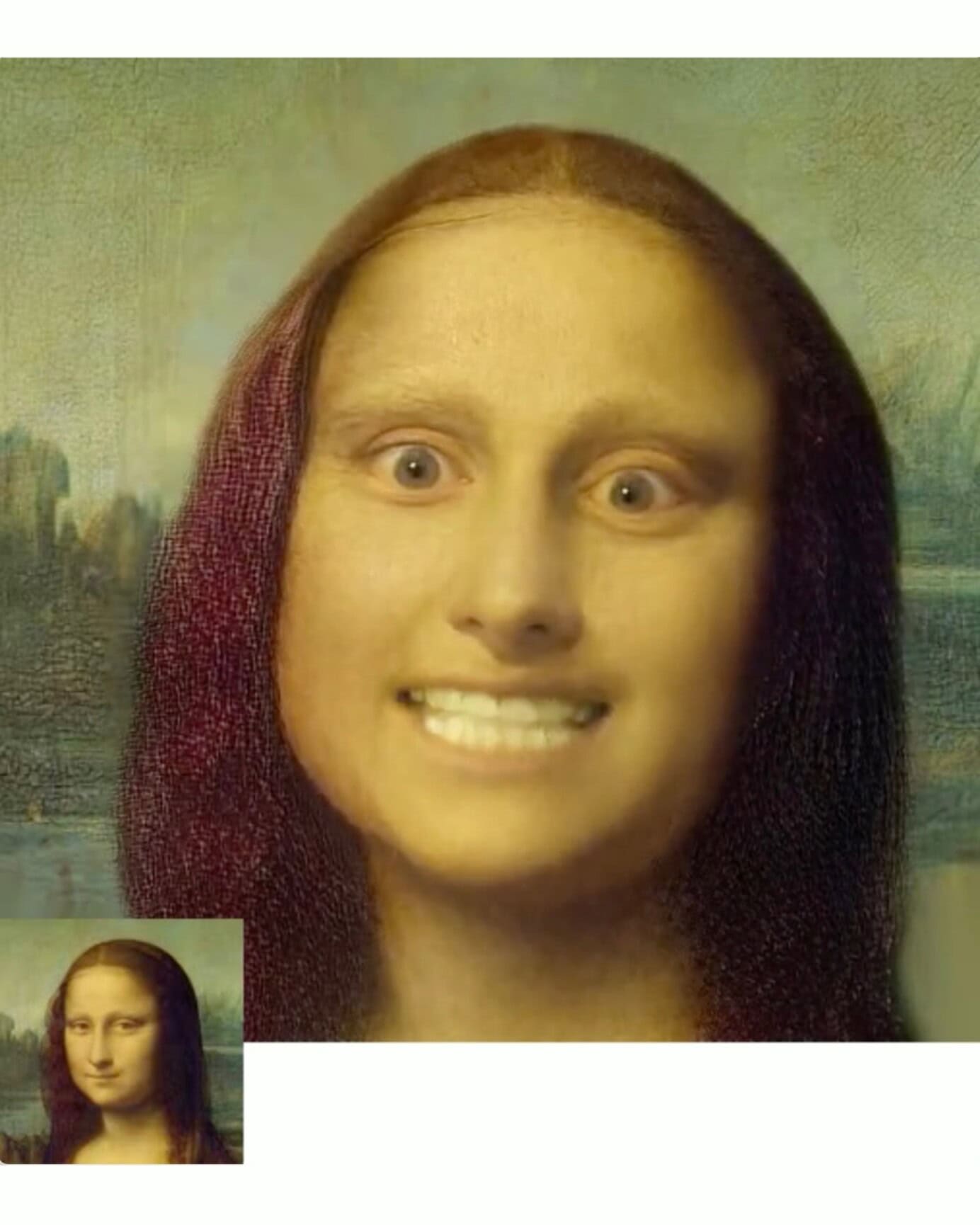

Nový model dokáže z jedinej fotografie a nahrávky hlasu generovať falošné video s falošným prejavom danej osoby a to dokonca aj v reálnom čase.

Generovanie falošných prejavov a výrokov známych osôb pomocou modelov umelej inteligencie nie je žiadnou novinkou. Spočiatku sa jednalo iba o napodobňovanie hlasu s tým, že samotnú fotografiu osoby nie veľmi presvedčivo rozpohyboval ďalší model, alebo bola tvár takejto známej osoby iba nakľúčovaná na tvár niekoho iného, kto sa za ňu vydával.

Prvým spôsobom generované video nepôsobí v praxi veľmi realisticky, druhý typ si zas vyžaduje množstvo času a skúseností s úpravou videí. Dostávame sa ale do fázy, kedy s presvedčivé deepfake video bude môcť vygenerovať každý a to nielen v priebehu sekúnd, ale aj v reálnom čase.

Čím nový model od Microsoftu vystupuje z radu ostatných, je v prvom rade rýchlosť. Video dokáže štandardne generovať v rozlíšení 512×512 pixelov pri 45 snímkach za sekundu. Pokiaľ by vám ale stačilo aj 40 snímok za sekundu, výsledné video dostanete okamžite, resp. pri použití grafickej karty NVIDIA RTX 4090 v priebehu 170 milisekúnd.

Druhou silnou stránkou nového modelu je jeho schopnosť pracovať správne s emóciami a mimikou tváre. Model so zvukovým prejavom synchronizuje nielen pohyb pier, ale aj zvyšné pohyby tváre, ktoré zodpovedajú intonácii a prejavu emócií priamo podľa obsahu nahrávky.

Model VASA-1 má veľký potenciál pre tvorbu zaujímavých edukačných či zábavných videí, výraznejšie sú však riziká. Rýchlosť a kvalitu modelu by mohli veľmi jednoducho zneužiť útočníci, ktorým už nie je použitie deepfake videí cudzie. Takúto technológiu už úspešne využívajú v rámci sociálneho inžinierstva, kde sú pomocou deepfake videohovorov schopní odcudziť desiatky miliónov eur.

Microsoft sa z tohto dôvodu rozhodol nevydať žiadne online demo, API ani produkt či službu postavenú na novom modeli. Neurobí tak minimálne do doby, kým si nebude istý, že v platnosti nie sú dostatočne silné regulácie, ktoré budú používanie podobných modelov korigovať. Ako prvá takúto reguláciu priniesla Európska únia a prvé kroky v tomto smere urobili aj ostatné štáty v rámci nezáväznej rezolúcie OSN.